ТОП просматриваемых книг сайта:

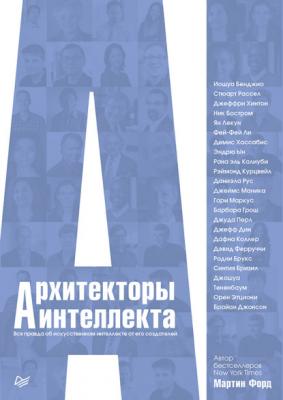

Архитекторы интеллекта. Вся правда об искусственном интеллекте от его создателей. Мартин Форд

Читать онлайн.Название Архитекторы интеллекта. Вся правда об искусственном интеллекте от его создателей

Год выпуска 2018

isbn 978-5-4461-1254-8

Автор произведения Мартин Форд

Жанр Прочая образовательная литература

Издательство Питер

Второй вопрос, который я задавал всем, касается ИИ, сравнимого с человеческим. Это так называемый сильный ИИ (artificial general intelligence, AGI), который был недостижимой мечтой. Демис Хассабис рассказал, что предпринимается в компании DeepMind, которая является крупнейшей и наиболее финансируемой инициативой по исследованиям сильного ИИ. Дэвид Ферруччи, руководивший разработкой суперкомпьютера IBM Watson, – генеральный директор стартапа Elemental Cognition, – описал создание сильного ИИ путем эффективного применения понимания языка. Важные идеи высказал и Рэймонд Курцвейл (Raymond Kurzweil) – автор книги Singularity is Near («Сингулярность уже близка»), в настоящее время руководящий проектом Google, связанным с обработкой естественного языка.

Всем я задал вопрос: «К какому году с вероятностью 50 % будет создан ИИ уровня человеческого?» Большинство предпочло поделиться своими предположениями анонимно. Двое из опрошенных выразили желание официально поделиться своей точкой зрения. Результаты этого опроса приведены в конце книги. Вы увидите, как мнения по важным темам зачастую кардинально расходятся, что представляет собой один из наиболее интересных аспектов данной книги.

Третья обсуждаемая тема связана с последствиями прогресса в области ИИ, ожидаемыми как в ближайшем, так и в отдаленном будущем. Становится очевидной проблема уязвимости взаимосвязанных автономных систем к атакам через интернет. Также выявлена предрасположенность алгоритмов машинного обучения к предвзятости по расовому и половому признакам. Многие из моих собеседников подчеркнули важность решения этой проблемы и рассказали об исследованиях в этой области. Некоторые дали оптимистический прогноз, предположив, что ИИ поможет нам избавиться от предвзятости и дискриминации.

Многих волнует опасность появления полностью автономного оружия. В сообществе исследователей ИИ существует мнение, что роботы или дроны, способные убивать без контроля человека, в конечном итоге могут стать не менее опасными, чем биологическое или химическое оружие. В июле 2018 г. более 160 компаний и 2400 исследователей (среди которых есть мои собеседники) подписали соглашение о запрете производства смертоносных алгоритмов[3].

Более отдаленной и умозрительной является проблема несоответствия собственных целей сильного ИИ с желаниями человека. Этой темы касались почти все мои собеседники. Чтобы адекватно и рационально осветить эту проблему, я поговорил с Ником Бостромом (Niсk Bostrom) из оксфордского Института будущего человечества (Future of humanity institute, FHI) – автором бестселлера «Искусственный интеллект: этапы, угрозы, стратегии»[4], в котором тщательно рассматриваются потенциальные риски, связанные с машинами, интеллектуально превосходящими человека.

Создатели интеллекта

Интервью для этой книги проводились с февраля по август 2018 г. Практически все они длились

https://futureoflife.org/lethal-autonomous-weapons-pledge/